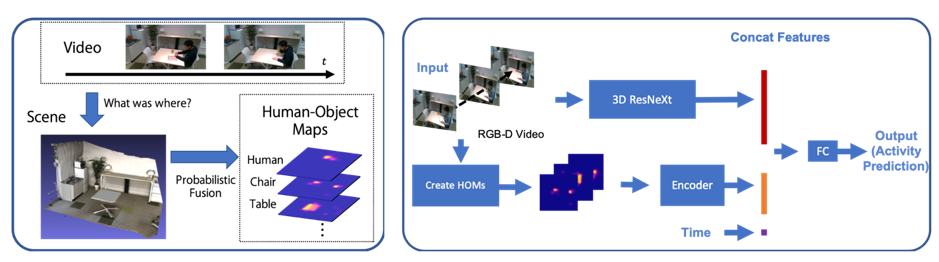

人と物体の存在確率を用いた日常行動認識

数分間・数時間と中長期に行われる日常行動では複数の細かいPrimitiveな行動が多く含み,動画のみの行動認識は難しい.本研究では,人と物体の存在確率マップを生成するシステムと,中長期に渡る人の日常行動データセットを構築し,人が「いつ」「どこで」「何と」「どのように」行動を行ったかの情報を特徴として利用し,同データセットで評価した.人と物体の存在確率を推定して特徴マップ化したHuman-Object Mapsを利用することによって中長期日常行動を高精度に認識することができた.

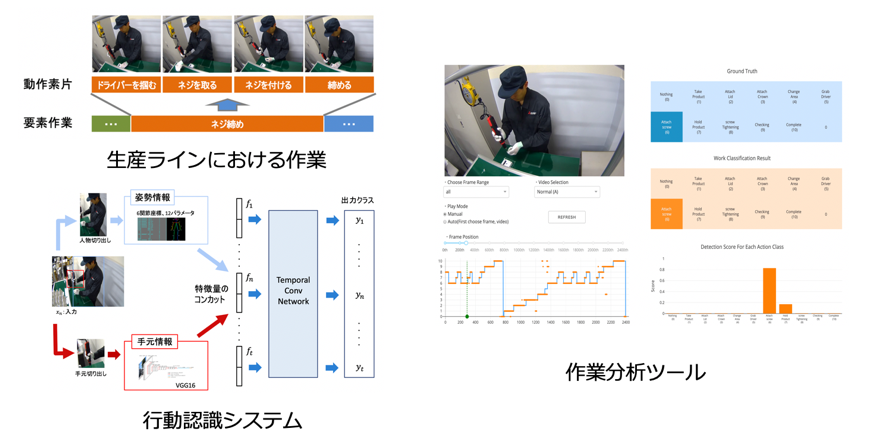

工場生産ラインにおける詳細行動認識

本研究では生産ラインの作業現場おける詳細行動認識を課題とし,各作業を更に細かく分割した動作素片単位における作業の認識を目指した.作業映像の特徴として,主に腕回りのみによる詳細な作業によって構成されているため,画像全体の情報から作業ごとの違いを捉えることは難しい点が挙げられる.そこで,腕の動きを捉えるための上半身の姿勢情報と,道具や手の動きを捉えるための手元情報に注目し,これらを組み合わせた手法を提案した.自作した少数データセットにおいて高い認識率とともに作業者,作業環境の変化に対する頑健性の確保を実現した.また作業分析ツールの作成により,認識結果の可視化も行なった.

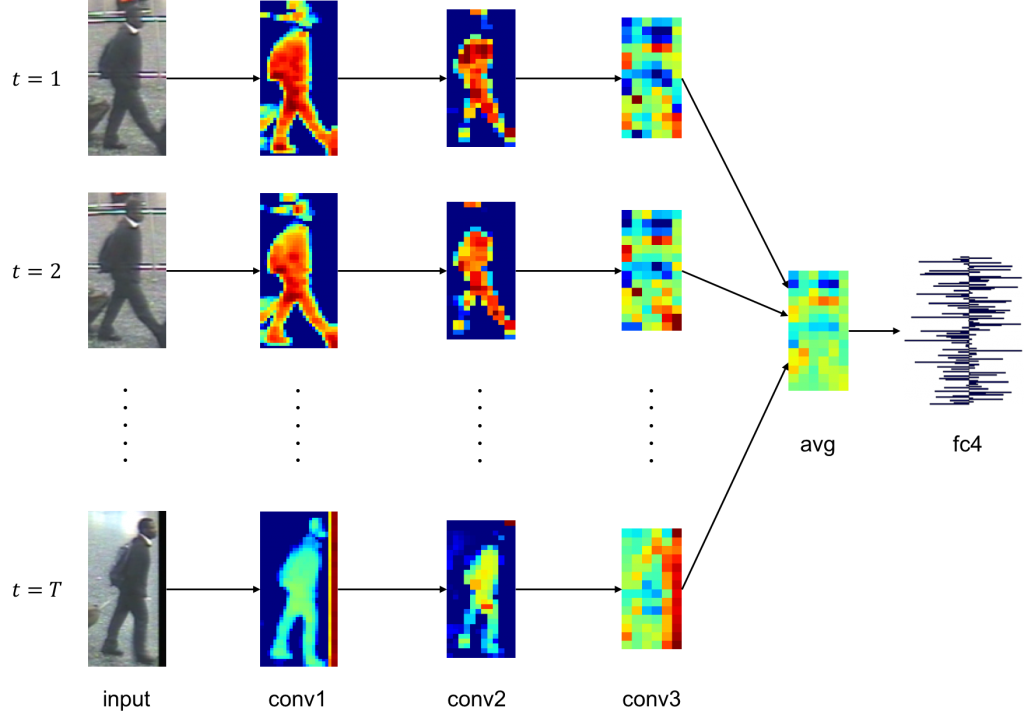

CNNを用いた距離学習による人物再同定

畳み込みニューラルネットワークにより動画像中の人物の類似度を学習することにより人物再同定を行う新たな手法を提案した.各人物動画は畳み込みニューラルネットワークにより特徴抽出がなされ,埋め込みベクトル同士の距離が直接人物間の距離指標に対応するようにユークリッド空間へと写像される.Entire Triplet Lossと呼ばれる改良されたパラメータ学習手法により,ミニバッチ内で取りうる全てのTripletの組が考慮された上で一度のパラメータの更新が行われる.このようなパラメータ更新手法の簡素な変更によりネットワークの汎化性能が大きく向上し,埋め込みベクトルがより人物毎に分離し易くなった.評価実験により,国際的なデータセットにおいて最先端の再同定率を達成した.

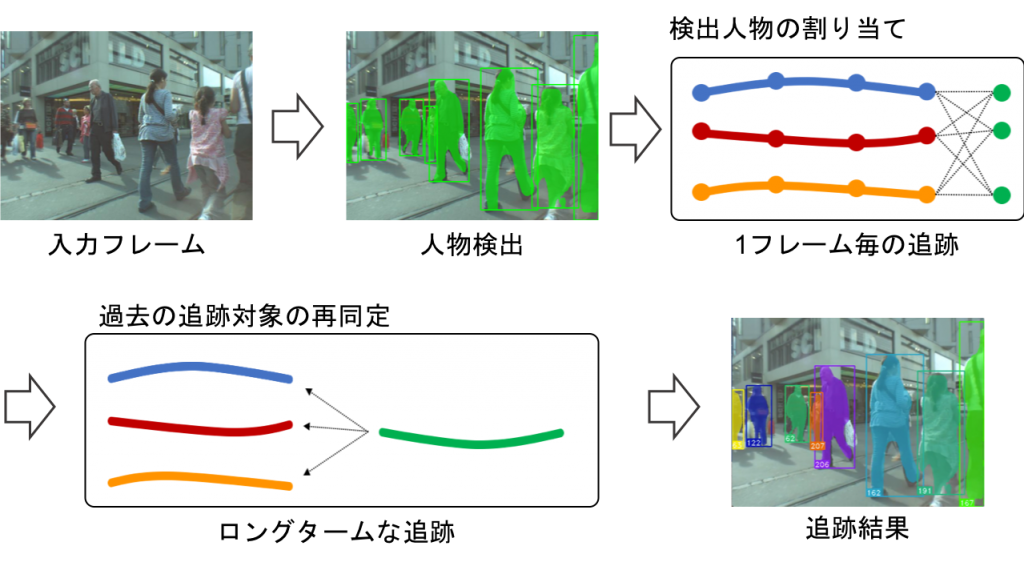

追跡軌跡の再同定を用いたオンライン複数物体追跡

オンライン処理による複数物体追跡の既存手法の多くは,動画の毎フレームで物体検出を行うことによって得られる物体矩形を時系列的に割り当てていくtracking-by-detectionのアプローチを取っている.しかし,既存手法では遮蔽などによって物体検出器で未検出となった対象を追跡することはできなかった.そこで,追跡軌跡の再同定により一度消失した対象を再び追跡状態へと移行させる手法を提案する.物体の高次元な見え特徴を表す埋め込みベクトルを畳み込みニューラルネットワークを用いて取得し,追跡軌跡同士の埋め込みベクトルの距離によって追跡軌跡の再同定判定を行う.このとき,ネットワークの入力に領域分割によって得られた物体のマスク画像を用いることで,背景変化に頑健な再同定判定を行うことが可能である.また,追跡軌跡ペアの再同定判定は低次元なベクトル同士の距離に基づいて行われるため,再同定判定を行うことによる計算コストの増加は僅かである.

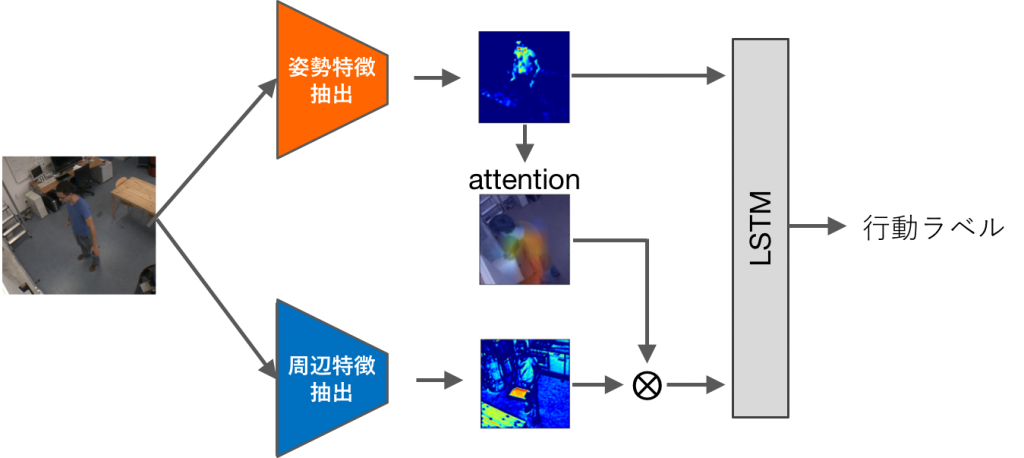

行動遷移映像における時系列行動認識

本研究では,複数行動が連続的に遷移していく映像を対象とした行動認識を課題とし,階層的なLSTMを用いて多様な時系列解析を行うことを提案した.また,環境変化に頑健な姿勢情報を中心としながら,周辺情報を付加的に学習させることと,姿勢特徴によって周辺特徴のフィルタリングを行うことで周辺特徴をより有効に活用することを提案した.データセットを用いた行動遷移映像における行動認識課題を対象に,従来手法からの改善を得ることが出来た.

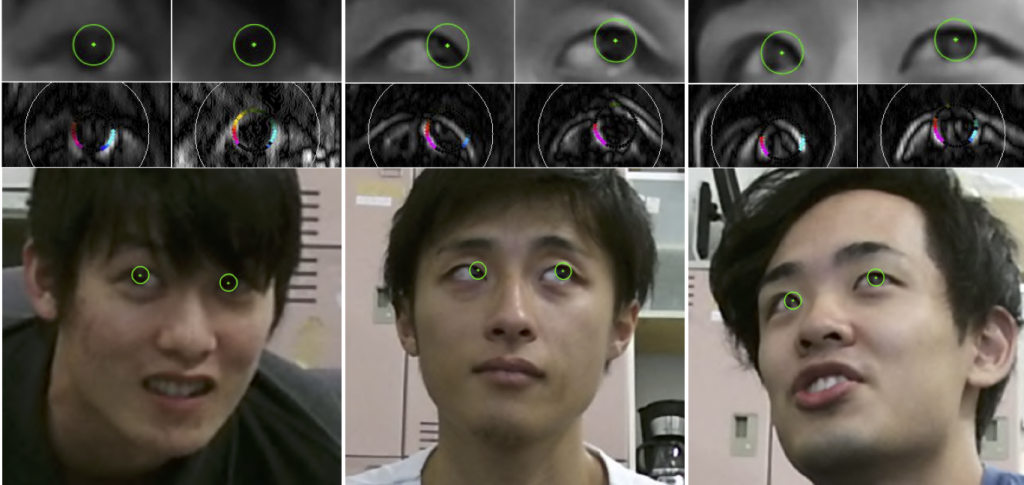

キャリブレーションフリー視線推定

既存の視線推定手法は,赤外線LEDや距離センサ等,特別な装置を用いたり,事前のキャリブレーション作業が必要なものが多かった.本研究では,社会での実利用に即した視線推定手法の実現へ向けて,キャリブレーションフリーかつカメラに対して広範囲な頭部位置で利用可能な注視点推定手法を提案している.解像度に依存しない頑健な虹彩追跡手法を基盤とし,顔特徴点検出,虹彩追跡,注視点推定から構成される視線推定手法により,広範囲空間内におけるキャリブレーションフリーな視線推定が実現可能であることを示した上で,様々な分野への応用を目指している.